[1] DeepPINK: reproducible feature selection in deep neural networks

Yang Young Lu, Yingying Fan, Jinchi Lv, William Stafford Noble

University of Washington, University of Southern California

深度学习由于出色的实证表现,在有监督和无监督机器学习中越来越受欢迎。

但是,大多数深度学习方法由于内在的复杂性,在很大程度上被视为可解释性较差的黑箱工具。

尽管最近已经有学者尝试得到深度神经网络(DNN)的可解释性,但是现有方法容易受到噪声影响并且缺乏鲁棒性。因此,科学家们对发现的可重复性持谨慎态度,这通常与底层统计模型的可解释性有关。

这篇文章提出了一种通过结合具有受控错误率的特征选择的方法,用来增加DNN的可解释性和再现性。作者们设计了新的DNN架构并将其与最近提出的仿冒框架集成,以可控的错误率进行特征选择。这种新方法DeepPINK(使用配对输入非线性Knockoff的深度特征选择)在模拟和实际数据集上都取得了较好的效果。

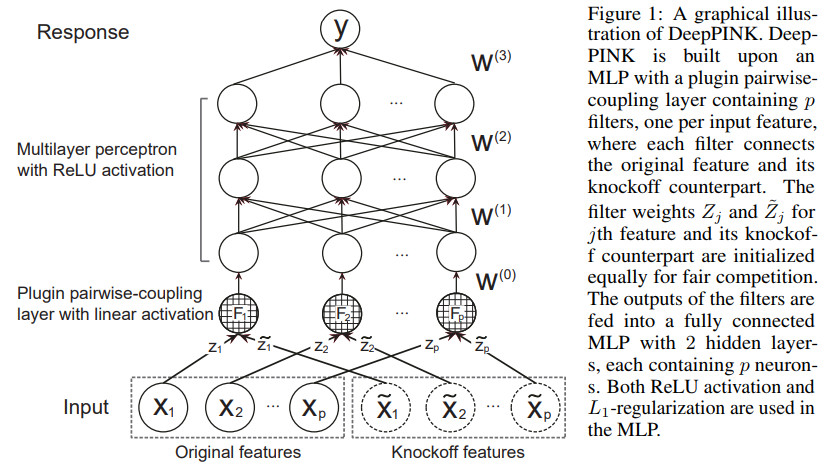

DeepPINK图示如下

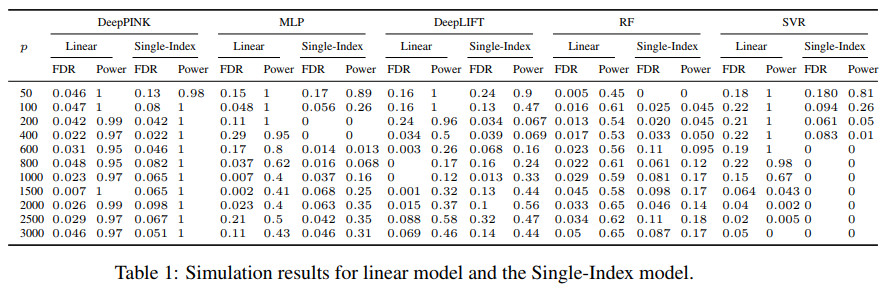

几种方法的效果对比如下

代码地址

https://github.com/younglululu/DeepPINK

[2] Learning Plannable Representations with Causal InfoGAN

Thanard Kurutach, Aviv Tamar, Ge Yang, Stuart Russell, Pieter Abbeel

University of California, University of Chicago

近年来,深度生成模型可以“想象”令人信服的高维数据,如图像,音频甚至视频,这种想象可以直接从原始数据中学习得到。

这篇论文给出了如何设想目标导向的视觉规划,即一个合理的观察序列,将动态系统从其当前状态转换到期望的目标状态,该规划用作控制的参考轨迹。本文专注于具有高维数据的系统,比如图像,并提出一种能够将表示学习和规划算法自然结合的方法。

本文所提出的框架能够学习连续观测数据的生成模型,其中生成过程是由低维计划模型中的转换和额外的噪声引起的。

通过最大化生成的观测值与规划模型中的过渡之间的互信息,能够得到一种低维表示,该表示可以最好地解释数据的因果性。作者们将规划模型构造成与高效计划算法兼容的模型,并且基于离散或连续状态提出多个这样的模型。

最后,为了生成视觉规划,作者们将当前和目标观测投影到规划模型中各自相应的状态,然后规划好一种轨迹,进而使用生成模型将轨迹转换为一系列观测数据。

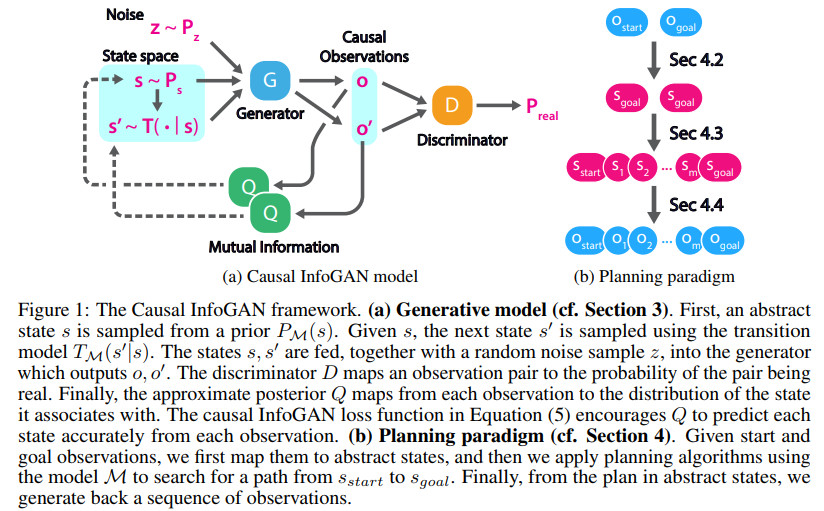

Casual InfoGAN模型及规划范式图示如下

多种隐含规划算法对比如下

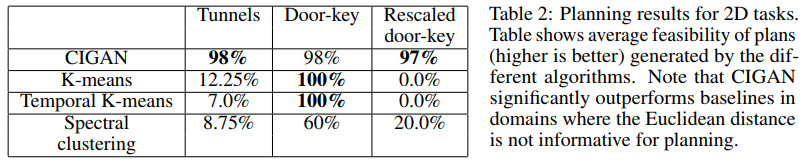

几种方法的效果对比如下

代码地址

https://github.com/thanard/causal-infogan

[3] Loss Surfaces, Mode Connectivity, and Fast Ensembling of DNNs

Timur Garipov, Pavel Izmailov, Dmitrii Podoprikhin, Dmitry Vetrov, Andrew Gordon Wilson

Samsung AI Center in Moscow, Skolkovo Institute of Science and Technology, Cornell University, Samsung-HSE Laboratory, National Research University Higher School of Economics

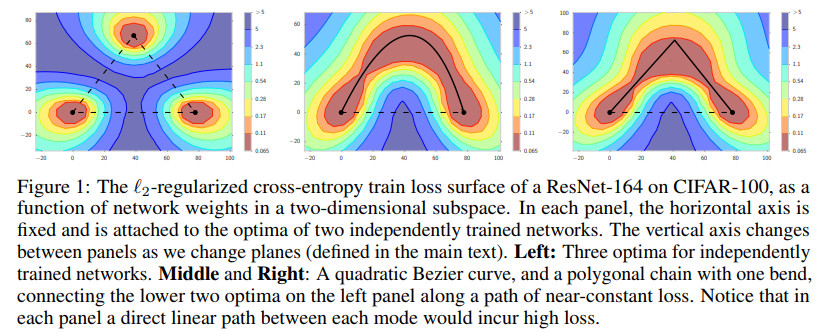

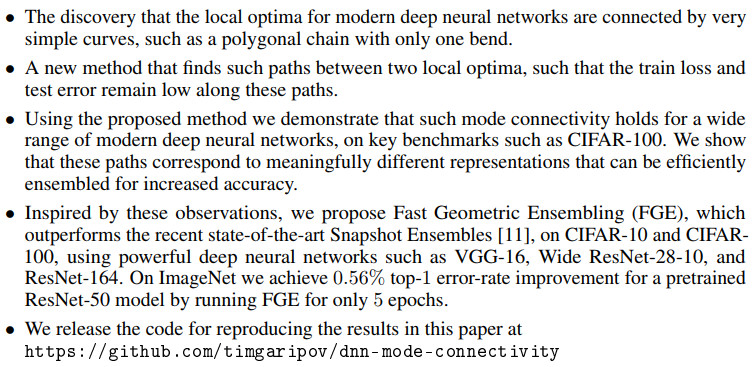

深度神经网络的损失函数比较复杂,这些损失函数的几何性质尚不清楚。实际上,这些复杂损失函数的最佳值是通过简单的曲线连接的,在这些简单曲线上训练和测试精度几乎是恒定的。

这篇文章介绍了一种训练过程,该过程能够发现模式之间的这些高精度路径。受这种新的几何洞察力的启发,作者们提出了一种名为快速几何集成(FGE)的新集成方法。使用FGE,在训练单个模型所需的时间内能够训练高性能的集成模型。

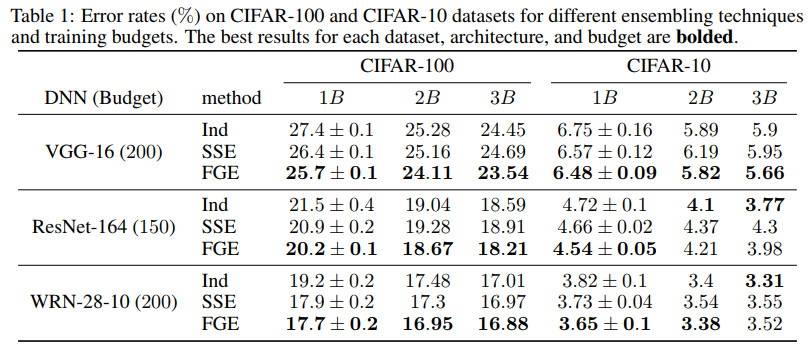

在CIFAR-10,CIFAR-100和ImageNet三个数据集上最新的快照集成模型相比,本文方法取得了更好的性能。

二维子空间中不同网络权重下带有l2约束的交叉熵训练损失曲面如下

这篇文章的主要贡献如下

l2约束的交叉熵训练误差和测试误差变化曲线如下

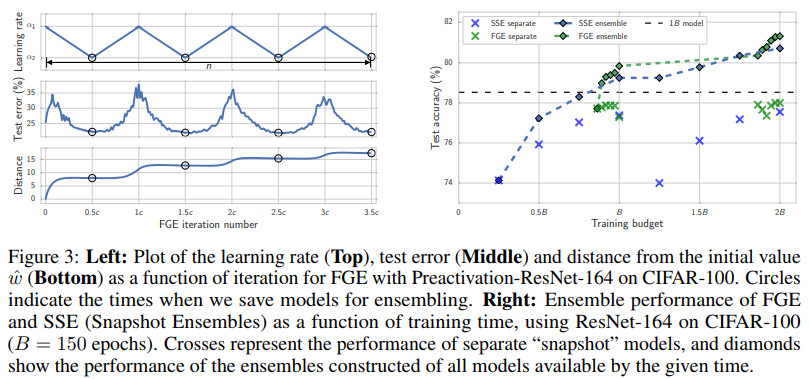

学习率、测试误差以及距离曲线;效果曲线如下

几种方法的错误率对比如下

代码地址

文章评论