[1] An intriguing failing of convolutional neural networks and the CoordConv solution

Rosanne Liu, Joel Lehman, Piero Molino, Felipe Petroski Such, Eric Frank, Alex Sergeev, Jason Yosinski

Uber AI Labs, Uber Technologies

在深度学习中,卷积产生了非常巨大的影响。只要是涉及像素或空间表示的问题, 通常都可以认为卷积神经网络可能适合用于解决该问题。

在这篇论文中, 作者们通过看似微不足道的坐标变换问题对上述假设给出了明显的反例, 该问题即为只需要学习 (x, y) 笛卡尔空间中的坐标和一个热像素空间中的坐标之间的映射。虽然卷积网络似乎适用于该问题, 但作者们发现结果惊人。

学者们首先对该问题的失败进行了演示和仔细分析, 然后, 他们给出了一种简单且明显的修复方法。该方案称为协同坐标卷积, 即通过额外的坐标通道, 使卷积作用于自身的输入坐标。

在不牺牲卷积的计算效率和参数效率的前提下, 协同坐标卷积可以按照最终任务的要求, 学到完整的平移不变性或不同程度的平移依赖关系。协同坐标卷积用于解决坐标变换问题是一种完美的泛化, 参数是卷积的1/100–1/10, 而且速度快150倍。

这种鲜明的对比引出一个问题: 这种无法卷积的情况在多大程度上潜移默化地延续到其他任务中, 进而阻碍了其性能?该问题的完整答案需要进一步探讨, 但初步证据表明, 协同坐标卷积中的卷积交换可以改进多个任务集的模型。

随着高层次空间延迟和像素之间的转换变得更容易学习, 在 gan 中使用协同坐标卷积能够产生较少的模式崩溃。对于在数据集 MNIST 检测任务中训练的Faster R-CNN 检测模型, 在使用协同坐标卷积时, IOU 效果提高了 24%, 在玩 Atari 游戏的强化学习 (RL) 域代理中, 使用协同坐标卷积层效果显著。

数据集图示如下

二维卷积及协同坐标卷积对比图示如下

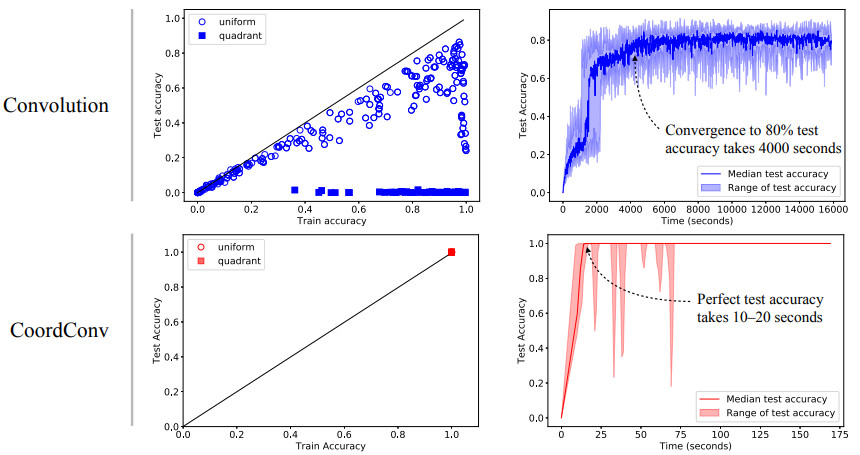

效果对比图示如下

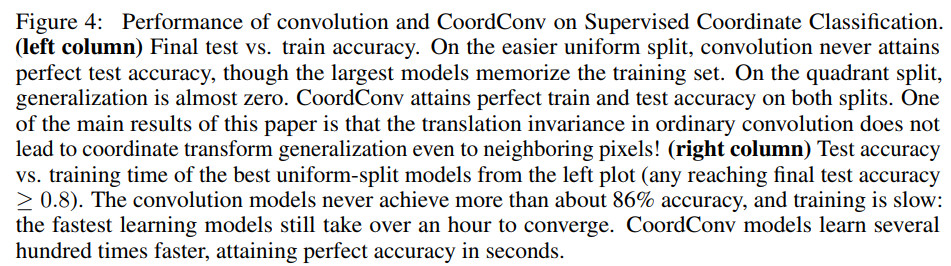

在分类和回归任务上的效果对比图示如下

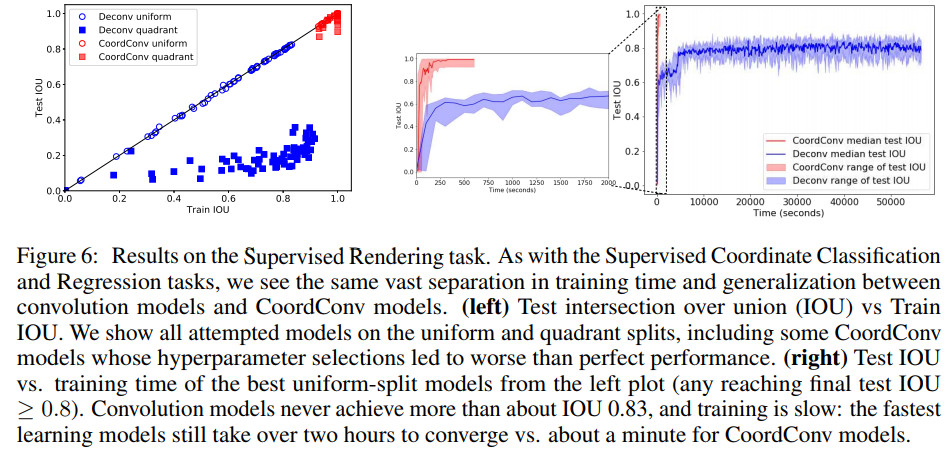

在图像渲染中的效果对比图示如下

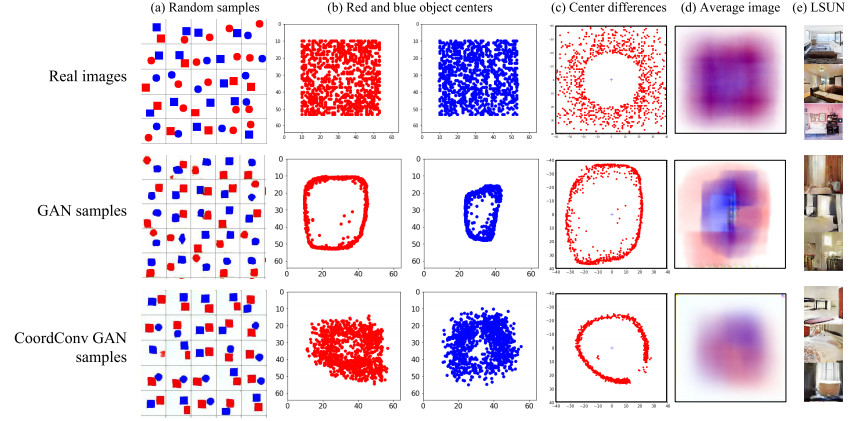

GAN与融入协同坐标卷积的GAN效果对比图示如下

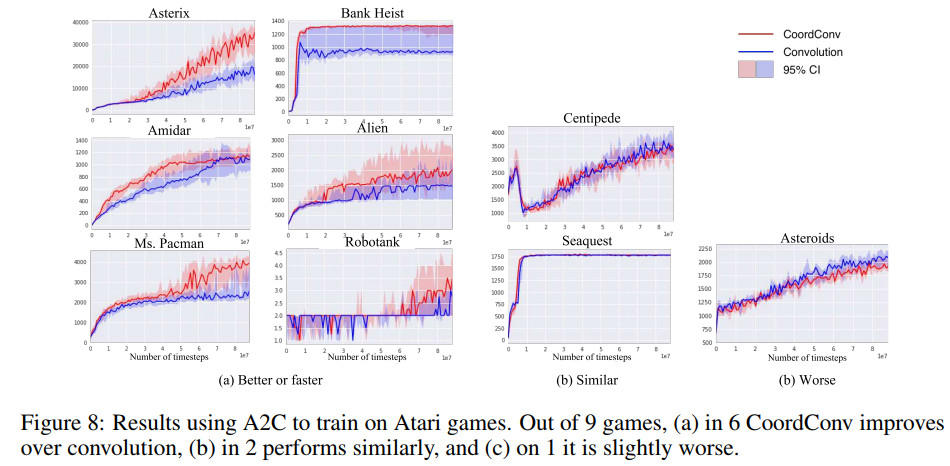

协同坐标卷积在强化学习中的效果图示如下

代码地址

https://github.com/uber-research/coordconv

[2] Invertibility of Convolutional Generative Networks from Partial Measurements

Fangchang Ma, Ulas Ayaz, Sertac Karaman

MIT

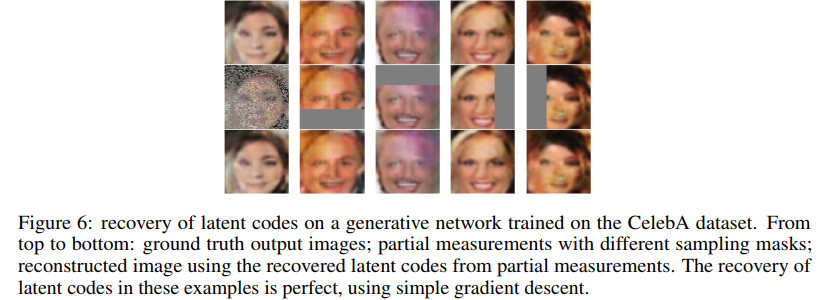

在图像修复问题中, 反转生成神经网络 (即通过部分网络输出来恢复输入的潜在编码) 引起了学者们的关注。最近有学者们重点研究了完全连接的网络如何用于图像修复。

本文针对卷积网络提出了新的理论结果, 并且在实际中得到了更广泛的应用。网络反演问题是高度非凸的, 因此通常计算非常困难, 并且无法保证最优值。

但是, 作者们证明了对于激活函数为ReLU 和随机权重服从高斯分布的两层卷积生成网络, 利用简单的梯度下降便可以有效地从网络输出中推导出输入的潜在编码。该新理论发现意味着, 在特定的假设下, 从低维潜在空间到高维图像空间的映射是一对一的。此外, 即使只观察到部分网络输出 (即缺少像素), 同样的结论依然成立。

作者们进一步证明了, 从经验上来说, 同一结论可以延伸到具有多层的网络、其他激活函数 (leaky ReLU、sigmoid 和 tanh) 以及在真实数据集上训练的权重。

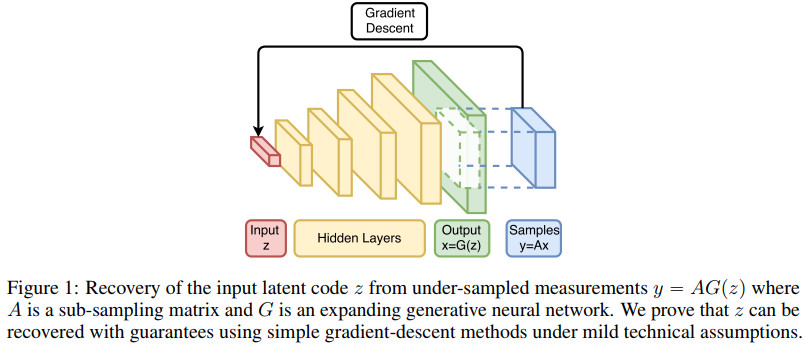

重构过程图示如下

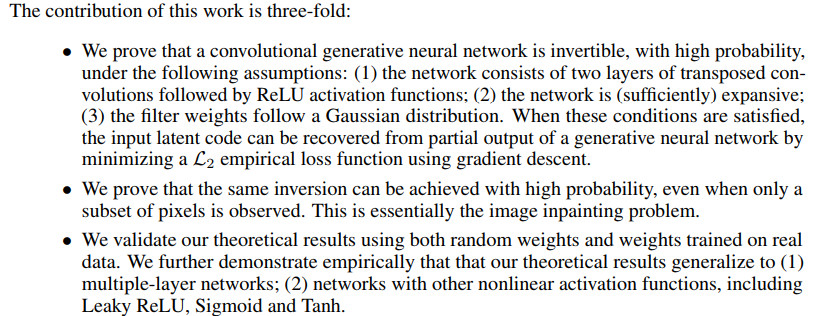

这篇论文的主要贡献如下

转置卷积操作图示如下

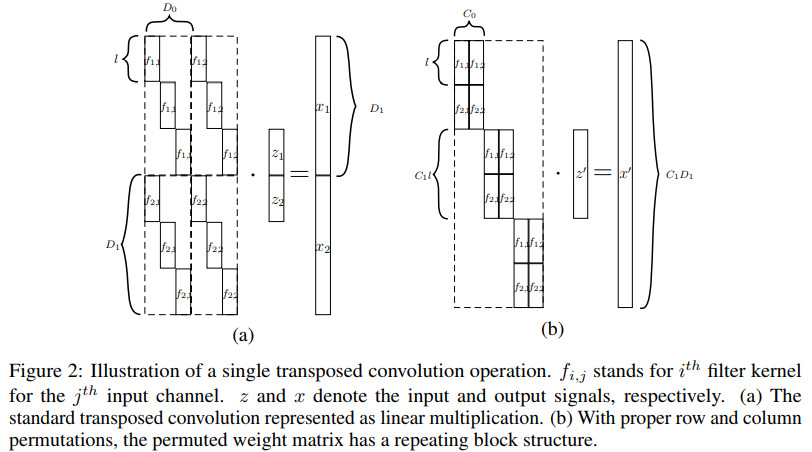

卷积生成网络各层权重分布的图示如下

反卷积网络中不同激活函数对应的损失函数的分布图示如下

在MNIST数据集上的效果图示如下

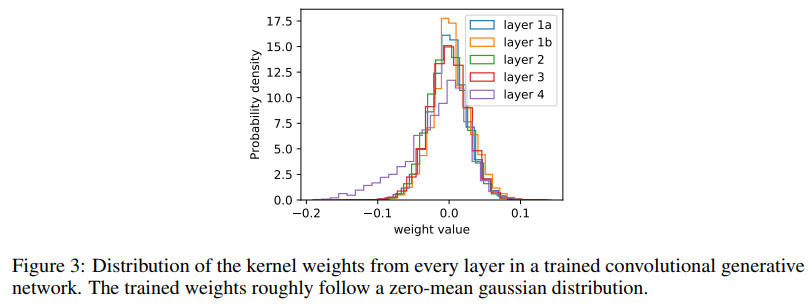

在数据集CelebA上的效果图示如下

代码地址

https://github.com/fangchangma/invert-generative-networks

[3] Towards Deep Conversational Recommendations

Raymond Li, Samira Ebrahimi Kahou, Hannes Schulz, Vincent Michalski, Laurent Charlin, Chris Pal

Ecole Polytechnique de Montréal, Element AI, Microsoft Research Montreal, Université de Montréal, Mila, HEC Montréal

利用神经网络和深度学习方法来创建对话系统越来越受关注。对话推荐是一种有意思的应用场景,该场景涉及了对话的科技探索,其中的对话将自然语言作为辅助,基于自然语言能够得到目标驱动的对话,而且这种对话可以自然地转化为更加自由的聊天。

这篇文章的主要贡献可以分为两点:

1,至今尚没有公开的大规模以推荐为主题的真实对话的数据集。为此,作者们收集了数据集REDIAL,该数据集包含超过10,000个对话,这些对话主要围绕着电影推荐。作者们将该数据集公开给社区,用于更进一步的研究。

2,作者们利用该数据集探索了对话推荐的多个层面。对网络结构,网络机制以及适合生成对话推荐系统的方法进了探索。

本文的数据集有助于系统的将模型子成分探索整个问题的不同子任务,其中包含了情感分析,冷启动推荐的生成,实际中如何将自然语言的细节用于对话推荐中。作者们将这些子成分组合起来进而构造了整体的对话系统。

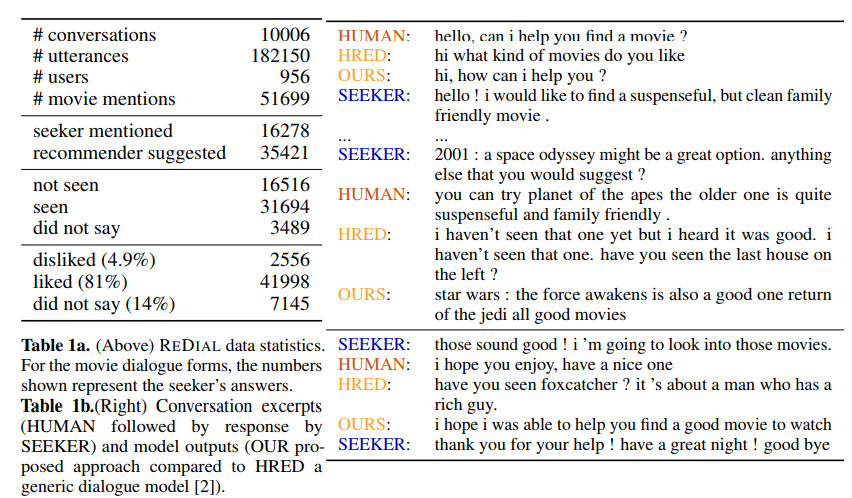

数据集统计及跟其他方法对比示例图示如下

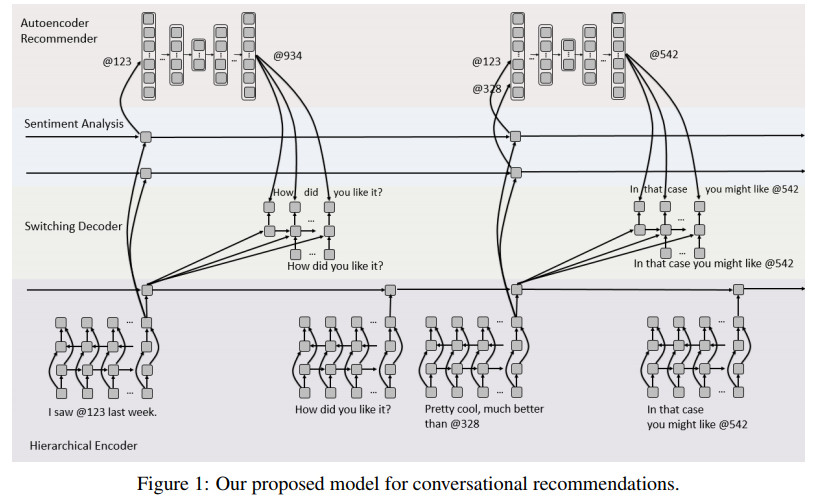

本文所提模型图示如下

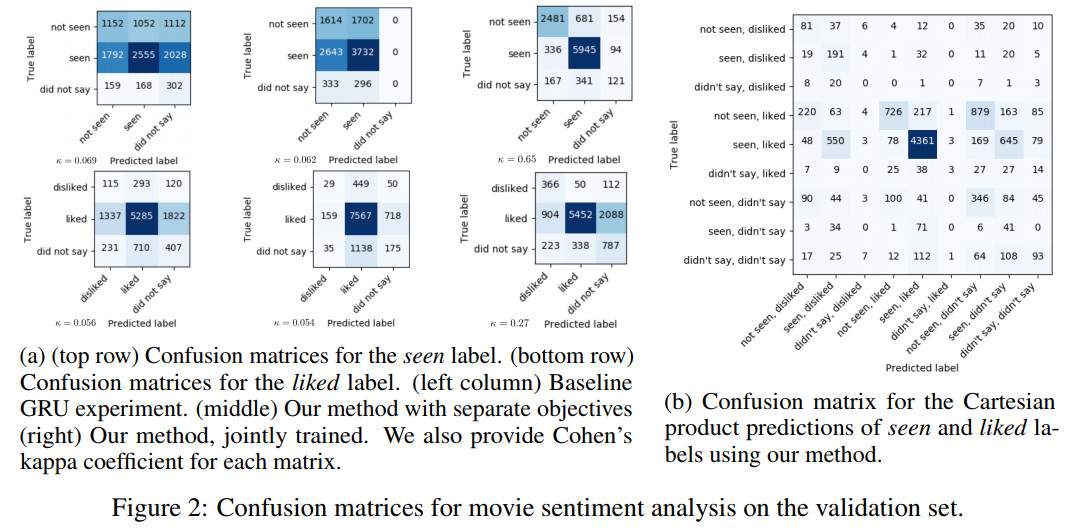

在验证集上的混淆矩阵如下

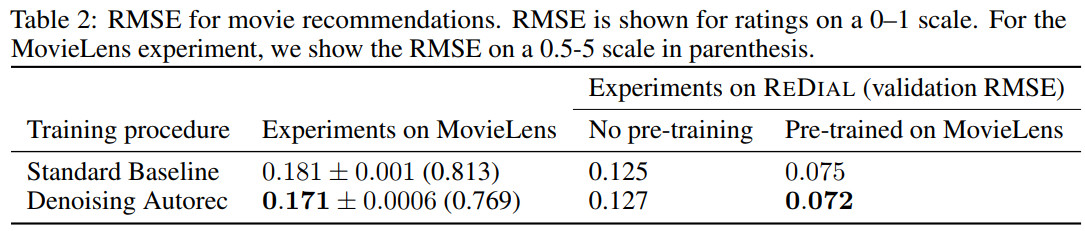

在不同数据集上的RMSE对比如下

对话质量评估结果对比如下

代码地址

https://github.com/RaymondLi0/conversational-recommendations

数据集地址

文章评论